A Verdade Escandalosa do AI na Saúde: É Seguro Confiar?

O Futuro É Sombrio se Não Olharmos Com Cuidado!

Prepare-se para a realidade chocante que ninguém está te contando!

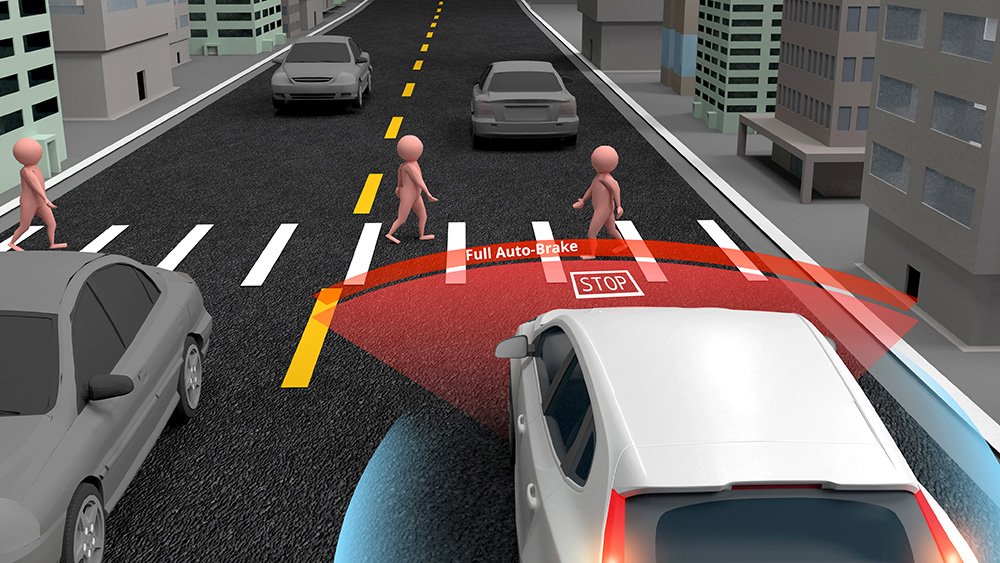

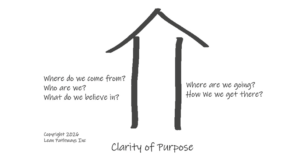

Quem, em sã consciência, iria se aventurar a entrar em um carro autônomo só porque as portas estão trancadas e o alarme está funcionando? Ah, não se engane! Esses recursos de segurança são apenas uma fachada, que protegem o veículo de ladrões, mas não garantem que a inteligência artificial consiga parar a tempo quando uma criança aparece na pista. E o que dizer nos perigosos cruzamentos? A verdadeira questão não é a segurança externa, mas sim a capacidade do carro de tomar decisões inteligentes. E é exatamente aqui que entra a balança do AI: segurança não é sinônimo de responsabilidade!

A Segurança Não é Tudo! O Que Realmente Está em Jogo?

Se você acha que a segurança dos dados é suficiente, acorda para a realidade! Tal como um carro superseguro, a segurança de informações em sistemas de AI na saúde é um dever, mas não garante que decisões perigosas não sejam tomadas com essas informações. ISO 42001 foi criado precisamente para preencher essa lacuna: para assegurar que as escolhas da inteligência artificial não se tornem um risco mortal. Sim, é isso mesmo! Estamos falando de vidas, não de meros números!

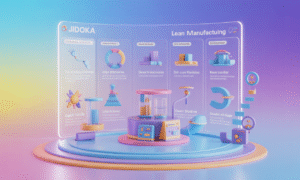

ISO 42001: O Novo Guardião da Ética em AI

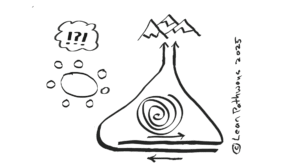

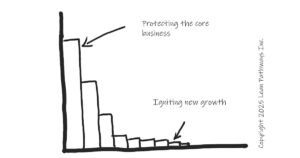

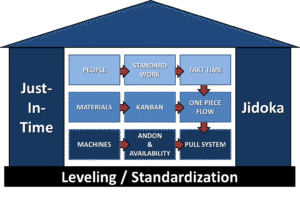

Entre as bandeiras brancas da segurança, ISO 27001 reina soberano na gestão da segurança da informação. Mas, adivinha? Isso não é suficiente para garantir que a AI esteja no controle. O que precisamos saber, de fato, é: a inteligência atrás do volante está tomando boas decisões? ISO 42001 não apenas protege contra ameaças externas, mas torna-se um juiz implacável do que acontece no interior da máquina. Aquele momento crítico em que as decisões precisam ser tomadas rapidamente? É isso que define o futuro!

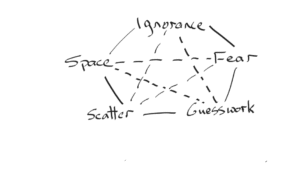

O Perigo da Confiança Cega: Chega de “Confie em Nós!”

Aqui vai uma fatídica verdade que vai te virar o estômago: nos EUA, fabricantes de dispositivos médicos só foram obrigados a provar a segurança de seus produtos a partir de 1976! Antes disso, um golpe de publicidade poderia fazer empresas alegarem cura para doenças fatais sem comprovação alguma. E cá estamos, numa nova era de promessas enganosas, onde empresas têm a audácia de dizer “confie em nós” sobre suas tecnologias de AI. Isso já foi, um dia, considerado aceitável! Já não é mais, e é hora de todo mundo se questionar: o que está por trás dessa cortina de fumaça?

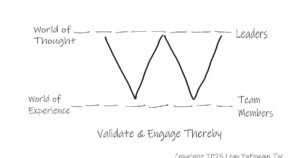

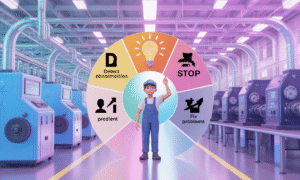

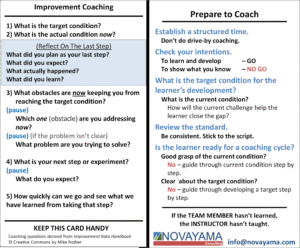

O Colaborador Humano: Onde a AI para e o Humano Assume

Vamos imaginar a AI nos setores de saúde como um estagiário supercapacitado, mas que, convenhamos, ainda é um estagiário. Ele pode até fazer um bocado de trabalho útil, mas nunca, em sã consciência, seria permitido que tomasse decisões finais sobre algo tão sério quanto a segurança do paciente! ISO 42001 enfatiza isso: a revisão do humano não é uma simples formalidade; ela é crucial! Sem supervisão humana, a inteligência artificial pode se tornar uma bomba-relógio à espera de explodir.

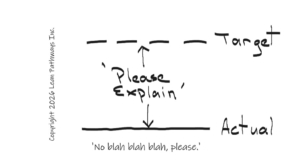

Auditabilidade: Se Não Pode Ser Auditada, Não Pode Ser Confiável

Um dos maiores pesadelos na governança de AI é quando os controles técnicos parecem mágicos e incompreensíveis. Você precisa de ferramentas que façam sentido e que possam ser auditadas como se fossem a bússola de um carro autônomo. A verdadeira questão aqui é: você consegue confiar em um sistema que não pode ser verificado? A resposta é um retumbante “não”! Os sistemas precisam garantir sua precisão e relevância sem deixar margem para erros.

Responsabilidade: A Crucial Linha de Controle

A responsabilidade em setores regulados deveria ser um conceito claro: cada decisão deve ser rastreada até uma pessoa específica que é a verdadeira dona da última palavra. Mas a AI complica tudo. Quando uma pessoa baseia suas decisões nas recomendações de uma máquina sem questionar, a responsabilidade desaparece. Isso é um desastre à espreita! ISO 42001 surge como um escudo, evitando que essas perguntas sobre responsabilidade apareçam somente durante crises.

Da “Confie em Nós” Para “Prove Isso!”

Ninguém quer entrar em um carro autônomo e passar o trajeto de forma nervosa, aterrorizado pela possibilidade de uma falha catastrófica. Queremos garantias! Assim como, na saúde, precisamos saber que cada aspecto do sistema foi minuciosamente testado e validado antes de comprometer a segurança de um paciente. É hora de as entidades responsáveis se despirem das ilusões e abraçarem a dura realidade: a segurança começa com responsabilidade e termina com confiança real!

E lembre-se: “Confie em nós”? Nunca mais! Com a AI, a hora de provar é agora!